初めまして、大阪国際工科専門職大学の2年で、AI戦略コースを専攻している米田と申します。

本記事では、インターン期間中に開発したシステムのうちの一つを紹介いたします。

VisionAssist

VisionAssistは、視覚障害を持つ人々が周囲の環境や物体を「見る」ことを支援するシステムです。このシステムは、写真の情報をテキストに変換し、それを音声で伝えることで情報アクセスの障壁を低減します。テクノロジーを活用して、より自立した日常生活を実現することを目指しています。

システム概要

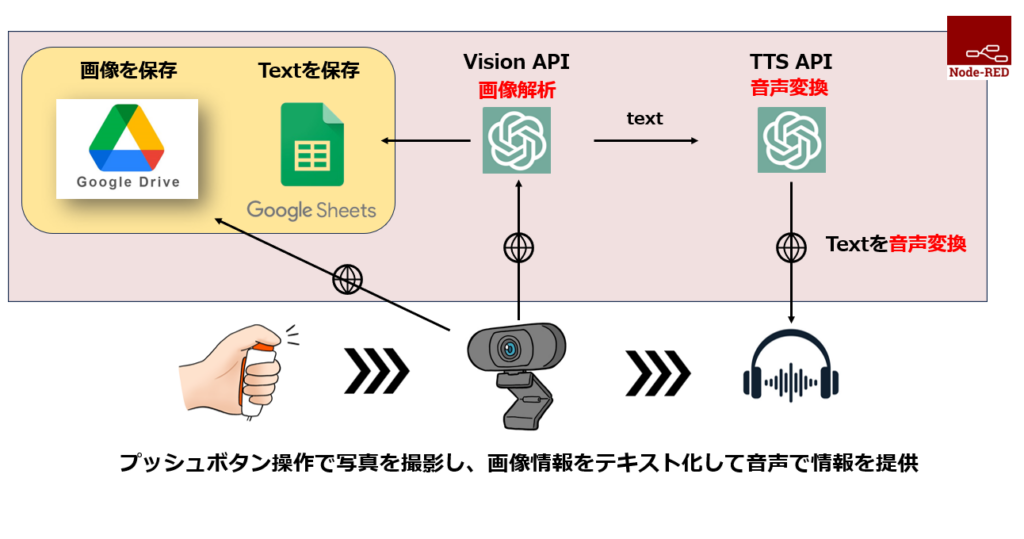

プッシュボタン操作で写真を撮影し、画像情報をテキスト化して音声で情報を提供します。このプロセスは、画像解析にVision API、音声変換にTTS APIを使用しています。Node-REDを用いてAPIコール、データフロー管理を行いました。

システム構成

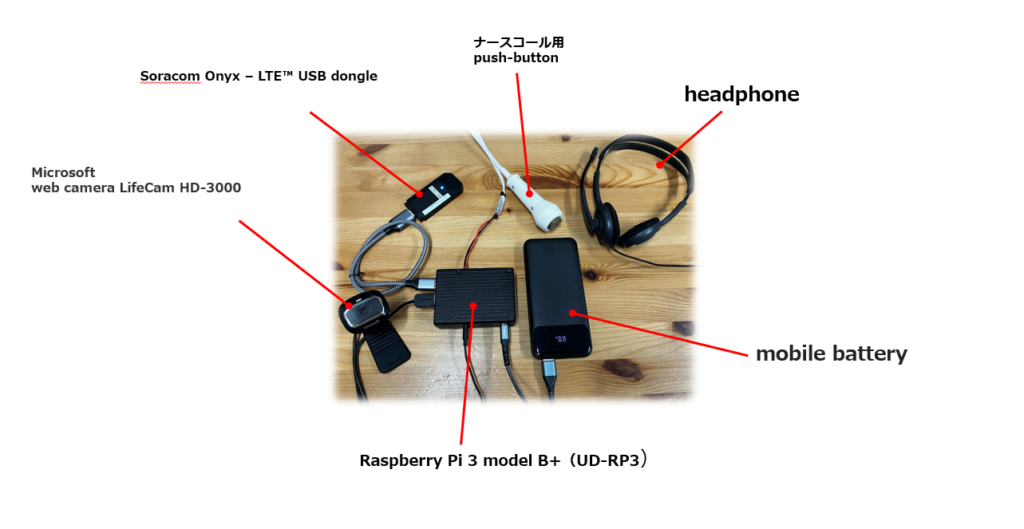

構成部品

実際に屋外で実験しました

VisionAssistは、テクノロジーと生活の融合を通じて、目の不自由な方が周囲の世界を深く理解し、日常生活を快適に過ごせるようにすることを目指して開発しました。AIの進化とハードウェアの組み合わせによって、私たちの生活や日常は大きく変わることと思います。未来への展望として、AIを生活を豊かにする道具として活用し、その可能性を探求し続けたいです。

最後に

このインターンを通して、AIの進化、開発の楽しさを体感することができました。三上さんからは、ビジネス、AI、IoTに至るまで、幅広い知識を学びました。貴重な経験をさせていただき、有難うございます。